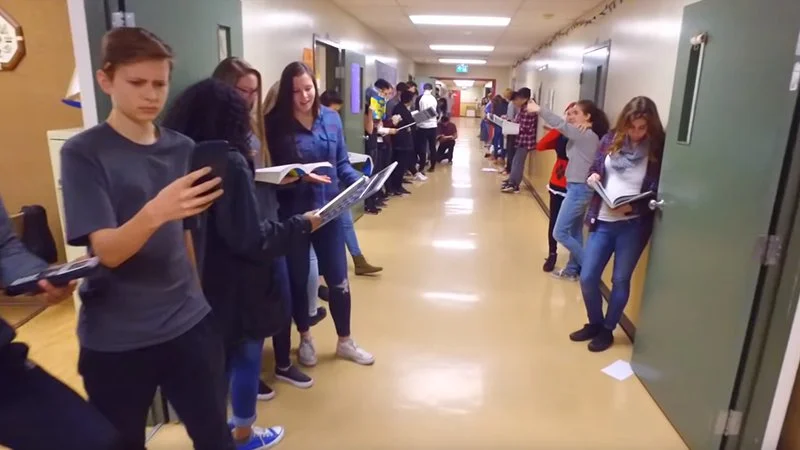

Podczas gdy Internet już dawno zapomniał o Mennequin Challenge, to naukowcy z Google dopiero postanowili to wyzwanie wykorzystać. Zebrali oni ponad 2000 klipów na temat tego wydarzenia i wykorzystali je do szkolenia sztucznej inteligencji.

Podczas gdy kamera się rusza, człowiek albo przedmiot nie musi tego robić. Jako ludzie zdajemy sobie z tego sprawę, lecz sztuczna inteligencja niekoniecznie. Percepcja AI nie jest idealna i często gdy kamera wykonuje ruch, to system uznaje przy tym, że obiekty otoczenia także to robią. Najnowsze szkolenie ma na celu udoskonalenie sztucznej inteligencji właśnie w tym aspekcie.

Naukowcy przekształcili wszystkie nagrania na obrazy 2D, oszacowali położenie kamery i stworzyli mapy głębi. AI była w stanie po badaniu przewidzieć głębokość obiektów z jeszcze większą dokładnością. Dzięki temu używane sieci neuronowe mają pomóc np. autonomicznym samochodom w zręczniejszym poruszaniu się po nieznanych obszarach.

Źródło: Engadget